La Inteligencia Artificial (IA) se ha convertido en parte esencial de la vida cotidiana, ya sea como fuente de consulta o como herramienta para optimizar tareas laborales y académicas. Sin embargo, un uso descuidado puede exponer a riesgos innecesarios.

Ante este panorama, ESET Latinoamérica, compañía líder en detección proactiva de amenazas, realizó una encuesta regional para identificar los hábitos de uso de la IA y las medidas de seguridad aplicadas al interactuar con estas herramientas.

La investigación incluyó a más de 1,000 personas de Venezuela, México, Colombia, Argentina, Perú, Guatemala, Chile, Ecuador, El Salvador, Uruguay, Panamá, Honduras, Costa Rica, Nicaragua, Bolivia, República Dominicana y Paraguay.

Uno de los hallazgos más relevantes es que el 80% utiliza la IA (45% de manera frecuente y 35% ocasional). No obstante, el 55% no verifica siempre la información obtenida: el 14% nunca lo hace y el 39% solo a veces. Para ESET, esta práctica representa un riesgo.

“Si bien los modelos de IA pueden entregar información certera, no están exentos de errores o sesgos. Por eso, para garantizar seguridad —especialmente en temas sensibles como legales, financieros o de salud— es recomendable contrastar la información con fuentes oficiales”, señaló Camilo Gutiérrez Amaya, jefe del Laboratorio de Investigación de ESET Latinoamérica.

Riesgos detectados en el uso de la IA

Los modelos de IA también pueden ser manipulados mediante técnicas como prompt injection, en las que un atacante introduce comandos engañosos para obtener respuestas erróneas o información falsa.

Otro dato preocupante: 40% de los encuestados comparte información personal o laboral con la IA (17% siempre y 25% a veces). Además, casi el 60% no lee las políticas de privacidad y solo la mitad toma medidas concretas para proteger sus datos.

ESET aconseja no ingresar contraseñas, datos bancarios ni información sensible en chats de IA, pues estos pueden almacenarse y usarse en el entrenamiento de futuros modelos. También recomienda revisar periódicamente las configuraciones de privacidad y los términos de uso.

Percepciones y preocupaciones

El estudio reveló que el 80% de los participantes ve la IA como algo positivo. Aun así, el 43% considera que será útil en el futuro, pero con riesgos asociados.

Entre las principales preocupaciones:

65%: fraudes y estafas

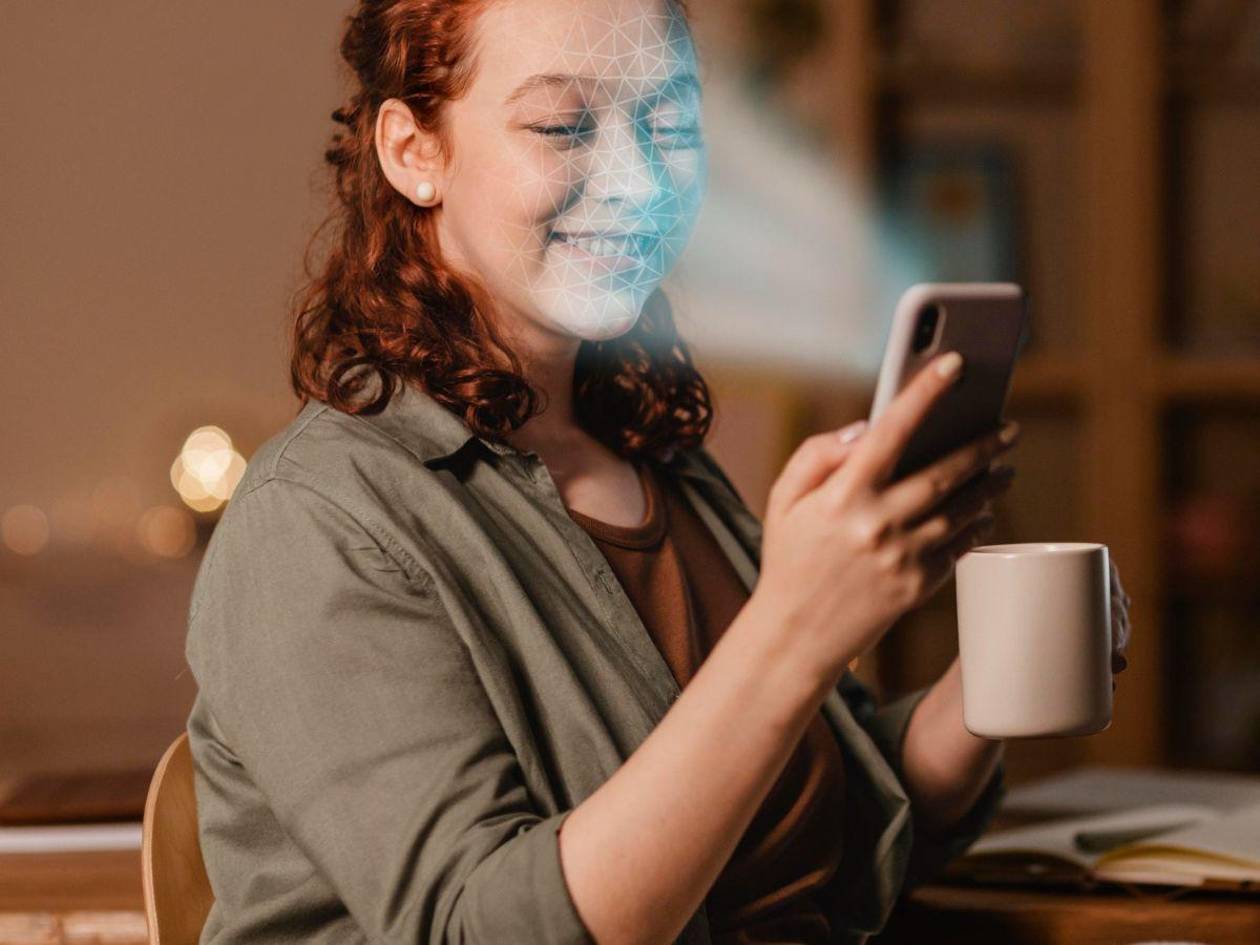

47%: deepfakes y noticias falsas

45%: falta de privacidad y recopilación de datos

“En relación con los fraudes, el cibercrimen ha encontrado en la IA una herramienta poderosa. Han aumentado los correos de phishing con textos generados automáticamente y estafas por audio, que pueden recrear voces con apenas unos segundos de grabación”, advirtió Gutiérrez Amaya.

Respecto a deepfakes y desinformación, citó un estudio del MIT que mostró que las noticias falsas tienen un 70% más de probabilidad de ser compartidas que las reales. Los ciberdelincuentes aprovechan estos contenidos en sitios web falsos para redirigir a páginas maliciosas y cometer fraudes.

En cuanto a la privacidad, ESET subraya la importancia de conocer qué datos almacenan las plataformas, si se comparten con terceros y de qué manera son usados.

“El análisis confirma que, pese a la alta adopción de la IA, aún falta un uso responsable y crítico. El desinterés en verificar información, la exposición de datos sensibles y la falta de atención a las políticas de privacidad son señales de alerta. El desafío es avanzar hacia un uso más consciente de la herramienta”, concluyó Gutiérrez Amaya.